¿Tiene sentido aprender a programar si los algoritmos ya lo hacen por nosotros?

Esa pregunta, que hasta hace poco era un ejercicio de futurología teórica, hoy atraviesa foros educativos, currículas universitarias y debates entre ejecutivos de las grandes empresas tecnológicas. Lo que antes era un consenso indiscutido —la programación como “el nuevo inglés”, una lengua franca de la modernidad digital— ahora empieza a tambalearse frente a la irrupción de los modelos de lenguaje generativos.

Durante dos décadas, enseñar a programar fue visto no solo como una puerta de acceso al mercado laboral, sino como una forma de entrenar el pensamiento lógico, estructurado y abstracto. Python, JavaScript, HTML: el ABC de la alfabetización digital. Pero en 2025, ese paradigma empieza a volverse incómodo. No porque el conocimiento se haya vuelto inútil, sino porque su función ha cambiado. Y sobre todo, porque la forma en que se accede a los resultados de ese conocimiento se ha transformado radicalmente.

En otras palabras: seguimos necesitando soluciones computacionales, pero ya no estamos tan seguros de que necesitemos humanos que las programen.

Un debate que ya no es académico

Hasta hace pocos años, decir que “todos deberían aprender a programar” era casi un dogma. Code.org impulsaba esa máxima desde campañas educativas globales. Personalidades como Barack Obama, Chris Bosh o Will.i.am prestaban su imagen para motivar a los jóvenes. Aprender a programar se proponía como un derecho educativo del siglo XXI. Se trataba de democratizar la creación digital, de no ser solo consumidores de tecnología, sino también autores de ella.

Pero la irrupción masiva de modelos como Copilot, ChatGPT, Gemini y Claude cambió la ecuación. Por primera vez en la historia de la informática, una herramienta puede recibir una orden escrita en lenguaje natural y responder con un bloque funcional de código. No uno simbólico, de ejemplo o decorativo: un código que puede compilar, ejecutarse y resolver un problema real.

Lo que parecía ciencia ficción en 2015 se volvió rutina en 2024. Hoy, un emprendedor sin conocimientos previos puede pedirle a un modelo de lenguaje que le construya una web, una base de datos, un sistema de login o incluso un pequeño motor de recomendaciones. Y si algo no funciona, puede pedirle que depure el error. Sin abrir un editor, sin conocer un lenguaje, sin pasar horas frente a Stack Overflow.

La pregunta ya no es “¿quién necesita programadores?”, sino mucho más incómoda: ¿hasta qué punto la habilidad de programar sigue siendo un diferencial humano?

Los líderes del futuro tech tampoco se ponen de acuerdo

El desconcierto no es exclusivo de los educadores ni de los jóvenes que evalúan qué carrera seguir. También los líderes del ecosistema tecnológico global parecen dudar. La propia industria que durante décadas promovió el aprendizaje del código como clave del progreso ahora se divide en dos bandos: los que consideran que saber programar ya no será necesario, y los que creen que es más importante que nunca.

Mark Zuckerberg, fundador de Meta, es uno de los que afirma que la programación tradicional está en vías de extinción. En su visión, la IA hará cada vez más trabajo técnico, y el rol humano se enfocará en definir qué queremos construir, no en cómo codificarlo. “El código lo escribirá la IA. Nosotros solo tenemos que tener claro qué deseamos”, dijo en una entrevista reciente.

Jensen Huang, CEO de NVIDIA, fue incluso más tajante: “Nadie debería necesitar programar nunca más”, afirmó en un evento corporativo. En su perspectiva, el futuro del desarrollo es conversacional: basta con decirle a una IA lo que querés hacer, y ella se encargará del resto. “Todo el mundo es programador, solo que no lo sabía”, remató. Lo que importa no es dominar un lenguaje informático, sino tener claridad conceptual para transmitir una idea.

Por el otro lado, voces como las de Thomas Dohmke, CEO de GitHub, defienden con fuerza la enseñanza de programación. Para él, el valor no está solamente en el código como producto final, sino en el proceso mental que implica resolver problemas lógicos, entender estructuras de datos, anticipar errores, pensar en capas. “Aprender a programar no es solo útil para programar —afirma—, es una forma de volverse más inteligente, de adquirir habilidades cognitivas transferibles a cualquier disciplina”.

A este punto de vista se suman otros gigantes del sector, como Bill Gates, que sostiene que saber programar en el siglo XXI es tan importante como haber aprendido álgebra en el siglo XX. Aunque la IA pueda hacer muchas cosas por nosotros, argumenta, no por eso deberíamos dejar de entender cómo funciona lo que usamos.

Una habilidad que deja huellas cognitivas

Más allá del debate técnico, hay una dimensión profundamente humana en juego: ¿qué significa aprender una habilidad sabiendo que puede volverse obsoleta? Esa pregunta no se limita a la programación. También podríamos hacérnosla sobre conducir un automóvil, usar una calculadora o memorizar información geográfica. Muchas de estas habilidades, aunque reemplazables por tecnología, siguen formando parte del tejido cultural que estructura nuestro pensamiento.

Aprender a programar no consiste solamente en escribir líneas de código: implica enfrentarse a problemas, descomponerlos en pasos lógicos, anticipar ramificaciones, manejar incertidumbre, iterar sobre soluciones. Es un entrenamiento mental que deja huellas profundas. No es casual que muchos filósofos de la mente contemporáneos vean en el pensamiento computacional una analogía útil para explicar procesos de razonamiento, toma de decisiones y resolución de conflictos.

Incluso si no escribimos código nunca más, el modo de pensar que la programación enseña sigue siendo valioso. Porque no se trata solo de decirle a una IA lo que queremos, sino de entender qué estamos pidiendo, con qué limitaciones, con qué consecuencias, con qué marco de referencia.

Y si no sabemos eso, el problema no será que programemos mal, sino que dependamos ciegamente de sistemas que ejecutan nuestras órdenes sin que nosotros sepamos realmente qué estamos ordenando.

La educación en pausa: repensar el valor del código en el aula

A mediados de los años 2010, las escuelas más innovadoras comenzaron a incluir programación en su currícula como parte de la llamada «alfabetización digital». Lo hacían no solo como una herramienta técnica, sino como una forma de introducir el pensamiento lógico, estructurado, con objetivos claros y resultados verificables. Se trataba de una especie de gimnasia mental en la que la recompensa no era solo el programa funcionando, sino el camino para llegar a él.

Pero algo se quebró en ese camino cuando las herramientas automáticas empezaron a ofrecer soluciones en segundos a problemas que requerían semanas de aprendizaje. ¿Cómo justificar el esfuerzo sostenido, la frustración y el ensayo-error si una IA puede ofrecer una respuesta correcta con solo una frase bien escrita? ¿Qué docente puede competir contra la inmediatez de un sistema que, en segundos, propone cinco versiones de una función, todas optimizadas y debidamente documentadas?

La paradoja educativa actual no es que los chicos no quieran aprender a programar. Es que cada vez más sienten que ya no tiene sentido. Como si el conocimiento técnico hubiera pasado de ser una llave a ser un callejón sin salida. Algunos docentes, frente a este escenario, bajan la exigencia. Otros intentan compensar con proyectos creativos. Pero la disonancia persiste: ¿tiene sentido enseñar a construir a mano una torre que otro puede levantar automáticamente en segundos?

Las universidades tampoco han encontrado una respuesta definitiva. En las facultades de ingeniería informática, los estudiantes se debaten entre el entusiasmo de usar la IA como aliada y el desconcierto de sentirse desplazados por ella. Las evaluaciones tradicionales, los ejercicios de algoritmia básica, la resolución de estructuras de datos: todo parece desfasado frente a herramientas que resuelven en minutos lo que un alumno promedio necesita horas para dominar.

Pero hay algo más profundo en juego. Si las herramientas cambian más rápido que los planes de estudio, la educación corre el riesgo de formar personas preparadas para un mundo que ya no existe.

El programador junior, especie en transición

La figura del programador junior, ese primer eslabón de la cadena profesional en las empresas de software, está en plena transformación. Durante décadas, se trató del primer peldaño natural: un rol destinado a tareas repetitivas, mantenimiento, debugueo, implementación de pequeñas funcionalidades bajo supervisión. Era un puesto formativo, con baja exigencia pero alto potencial de crecimiento.

Hoy, muchas de esas tareas ya no requieren intervención humana. Los modelos de lenguaje son capaces de generar funciones enteras, revisar errores, sugerir mejoras y escribir test cases automáticamente. Y lo hacen sin descanso, sin distracciones, sin necesitar onboarding. No se enferman, no se frustran, no exigen aumentos salariales.

El resultado es previsible: muchas empresas pequeñas y medianas, especialmente en mercados donde el costo laboral es alto, han comenzado a prescindir de juniors y a integrar herramientas automáticas en su flujo de trabajo. No es que desaparezcan todos los puestos de entrada. Pero sí se reducen, y se encarecen las exigencias para ocuparlos. Lo que antes era un escalón accesible ahora se vuelve una carrera de obstáculos.

La pregunta es: si no hay más puerta de entrada para aprender haciendo, ¿dónde se forman los próximos programadores seniors? ¿Cómo adquirir experiencia si no hay espacio para equivocarse? La paradoja se hace evidente: se necesita talento con criterio para supervisar la IA, pero se eliminan los espacios donde ese criterio se cultivaba.

Los nuevos perfiles híbridos

Ante este panorama, empieza a emerger una nueva clase de profesional: alguien que no necesariamente domina todos los lenguajes de programación, pero sí entiende cómo funcionan los modelos de IA, cómo dar instrucciones claras, cómo iterar, refinar, validar, supervisar. Ya no hablamos solo de developers, sino de orquestadores. De estrategas digitales. De interlocutores hábiles entre el lenguaje humano y el funcionamiento del sistema.

Son perfiles que combinan habilidades técnicas básicas con competencias blandas: capacidad analítica, pensamiento crítico, escritura clara, comprensión de procesos y lógica conversacional. Lo que antes se consideraba “accesorio” (saber comunicar, redactar bien, pensar en producto) hoy se vuelve esencial.

En algunas startups, ya existen roles como prompt engineer, AI supervisor o data dialogue specialist. Son personas que no escriben cada línea del backend, pero sí deciden qué problema resolver, cómo plantearlo, qué prioridades seguir y cómo asegurarse de que la solución propuesta sea sólida, segura y funcional.

Estos perfiles no reemplazan al programador clásico, pero sí compiten por su centralidad. El desarrollo de software deja de ser una tarea de nicho para convertirse en un proceso más amplio, donde la escritura de código ya no es el núcleo del trabajo, sino una de sus derivaciones.

Un cambio cultural más que técnico

Este cambio no se reduce a una cuestión de eficiencia. Tiene implicancias culturales profundas. Aprender a programar, durante muchos años, fue parte de una identidad: la del hacedor, del que podía construir desde cero, del que entendía lo que otros usaban sin saber. Hoy, esa figura enfrenta un dilema generacional.

Los programadores experimentados sienten que el oficio está perdiendo su mística. Que escribir código “a mano” se está volviendo un gesto romántico, casi artesanal. Algo reservado para quienes buscan entender a fondo, pero que ya no es necesario para lograr resultados. En el otro extremo, las nuevas generaciones no sienten nostalgia por una práctica que no vivieron. Usan las herramientas más poderosas que tienen a su alcance, y si eso incluye pedirle a la IA que codifique, no ven por qué deberían hacerlo distinto.

El riesgo no es solo la pérdida de una técnica, sino de una ética del trabajo digital. Cuando todo puede ser resuelto en segundos, se pierde la noción del proceso, del tiempo invertido, del valor del detalle. El software deja de ser un arte minucioso para convertirse en una commodity. Y con ello, cambia también la relación entre el creador y su creación.

¿Programar sin programar?

La frase suena absurda, incluso contradictoria. Pero define mejor que ninguna otra lo que está ocurriendo hoy con el desarrollo de software. Programar ya no siempre implica escribir código. De hecho, muchas veces, programar es pedir. Es describir una lógica, una función, un comportamiento, en un lenguaje que no necesita llaves, corchetes ni punto y coma. Basta con tener claridad. O al menos, suficiente claridad como para que la IA la traduzca en algo operativo.

El fenómeno no es del todo nuevo. Desde la aparición de herramientas como Scratch o App Inventor, el desarrollo visual y las interfaces simplificadas han intentado bajar la barrera de entrada. Pero lo que cambia con la IA generativa no es solo la interfaz: es el intérprete. Ya no hablamos con bloques prearmados, sino con entidades que interpretan lenguaje humano, lo reescriben, lo optimizan y lo implementan. Lo hacen en cualquier lenguaje, con distintos marcos, para múltiples plataformas. Y lo hacen de manera personalizada.

La consecuencia es radical: saber programar ya no garantiza saber construir. Pero saber pensar bien lo que se quiere construir, sí puede bastar para programar. Esa inversión semántica cambia todo. Y obliga a reformular lo que entendemos por alfabetización digital. Quizás, en un futuro cercano, enseñar a programar no sea enseñar a escribir código, sino a dialogar eficazmente con las máquinas que lo escriben.

¿Qué pasa con los lenguajes clásicos?

Python, Java, C++, JavaScript, Rust, Go. Durante años, dominar uno o varios de estos lenguajes era un capital tangible. El programador se definía por lo que “sabía escribir”. Por los entornos que conocía. Por las convenciones, las librerías, los frameworks, los trucos. Incluso por las guerras tribales entre lenguajes. Pero esa época se desvanece.

No porque el código desaparezca, sino porque su centralidad se desplaza. Los lenguajes siguen existiendo, pero se vuelven invisibles para quienes no desean usarlos. Un emprendedor puede construir un MVP completo sin saber si está escrito en Node o en Django. Un equipo de marketing puede automatizar reportes en Sheets con scripts que no redactaron. Un diseñador puede crear prototipos funcionales con extensiones de Figma sin escribir una línea.

Los lenguajes clásicos no mueren, pero se desdibujan. Se vuelven infraestructura. Como las tuberías, como el HTML, como el voltaje. Son parte del ecosistema, pero ya no están en la superficie de la experiencia. Solo emergen cuando hay una falla, un límite, una necesidad precisa. Entonces reaparecen los especialistas. Pero mientras tanto, el usuario opera por encima de ellos, con un nivel de abstracción que hace unos años era impensable.

Eso no los hace menos importantes. Los hace más invisibles. Y, como toda tecnología invisible, más poderosa.

Educación pública, brecha y desafío

En los países con mayor acceso a tecnología, el debate se da con un tono sofisticado. Se habla de reconversión laboral, de nuevos perfiles, de “reskilling”. Pero en América Latina, África o el sudeste asiático, el panorama es otro. Allí, aprender a programar sigue siendo una puerta de salida de la precariedad. Un recurso para acceder a un mercado global, cobrar en moneda fuerte y escalar socialmente sin necesidad de migrar.

En ese contexto, decir que ya no hace falta programar puede sonar, al menos, prematuro. O directamente cruel. Porque los modelos que automatizan el código están entrenados con miles de millones de líneas escritas por personas que, en su mayoría, no acceden a los beneficios de esa automatización. Porque la IA que permite programar sin saber programar no surge del vacío, sino del trabajo acumulado de generaciones enteras de programadores humanos.

El riesgo es doble. Por un lado, dejar de enseñar programación en contextos donde aún es una herramienta de inclusión. Por otro, formar jóvenes que creen que basta con saber pedir, sin saber lo que están pidiendo. Esa asimetría no es solo tecnológica: es política. La brecha ya no es entre quienes tienen o no acceso a Internet, sino entre quienes entienden lo que las herramientas hacen y quienes simplemente las usan. Entre quien guía el sistema y quien es guiado por él.

Por eso, más que eliminar la enseñanza de programación, habría que repensarla. No para formar operarios del teclado, sino ciudadanos capaces de entender, cuestionar y modelar las lógicas algorítmicas que estructuran el mundo digital.

El poder de programar sigue intacto

Aunque ya no todos escriban código, el poder de programar no ha desaparecido. Solo se ha desplazado. Programar, en el sentido más profundo, no es solo ordenar instrucciones a una máquina. Es modificar el entorno. Es pensar en términos de procesos, condiciones, iteraciones, efectos. Es saber construir una solución que se mantiene en el tiempo, se adapta, escala, resuelve.

Ese poder, cada vez más, se canaliza a través de herramientas nuevas, pero no por eso deja de ser poder. Un usuario que define las reglas de un workflow automatizado en Make, que entrena un modelo personalizado en Claude o que configura una cadena de agentes autónomos, está programando. Incluso si nunca escribió for i in range ().

Y ese poder no es menor. Al contrario: en un mundo cada vez más interconectado, quien puede diseñar el comportamiento de un sistema, sea cual sea la interfaz, tiene una ventaja estratégica. Puede optimizar procesos, reducir errores, escalar resultados, delegar tareas, crear nuevos productos. No necesita saber cómo funciona cada engranaje, pero sí tener criterio sobre qué quiere que ocurra.

El futuro, entonces, no es de quien memoriza reglas, sino de quien diseña sistemas. De quien entiende que programar es gobernar, aunque ya no se parezca al acto de escribir código en una terminal negra con letras verdes.

¿Qué queda cuando ya no hace falta escribir?

En 2025, programar ya no es un acto reservado a especialistas. Tampoco es una garantía de pertenencia a la élite tecnológica. Es, en el mejor de los casos, una capa más de una red mucho más compleja donde intervienen modelos predictivos, procesamiento del lenguaje natural, sistemas multiagente y arquitecturas distribuidas que se autoajustan. Lo que entendíamos por “saber programar” ya no es suficiente. Pero, curiosamente, tampoco ha perdido valor. Solo ha cambiado de lugar.

Ya no alcanza con repetir estructuras lógicas, pero tampoco basta con formular deseos vagos esperando que la máquina los resuelva. El pensamiento computacional —esa capacidad para estructurar un problema, identificar patrones, descomponer procesos, anticipar comportamientos y traducir ideas abstractas en acciones sistemáticas— sigue siendo central. Solo que hoy debe expresarse en un lenguaje más híbrido, más flexible, más abierto al diálogo con lo inesperado.

El futuro no pertenece al que sabe todo, sino al que puede combinar lo que sabe con lo que la máquina puede hacer. Esa alianza no es natural ni automática: requiere entrenamiento, reflexión, criterio. Justamente por eso, si hay algo que debería enseñarse más que nunca, no es solamente a programar, sino a pensar en términos de sistemas.

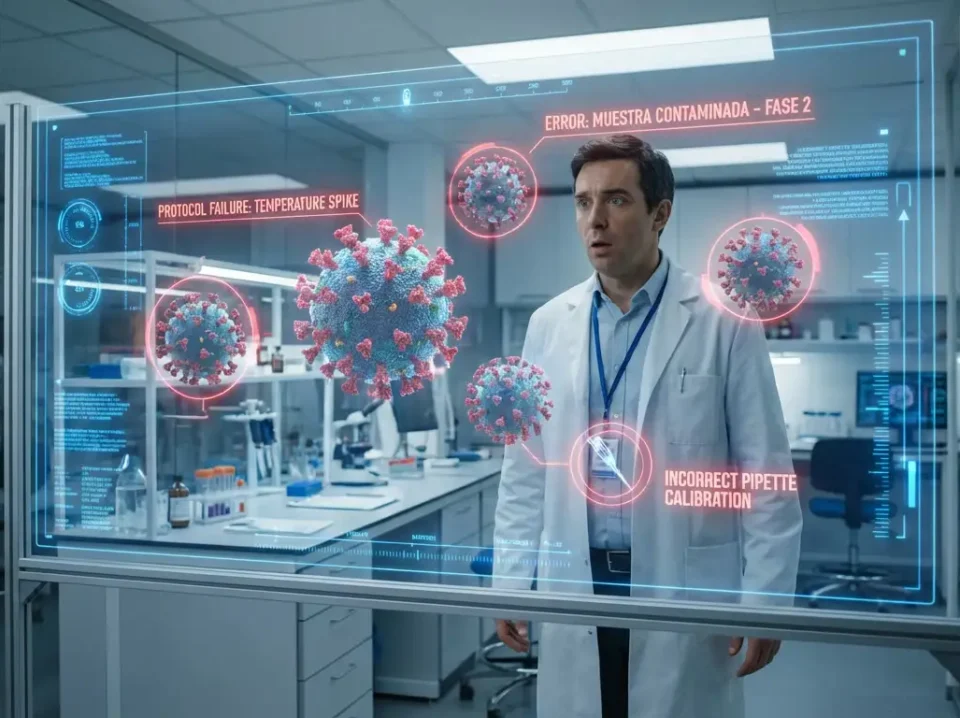

Más allá del código: pensamiento, criterio, consecuencias

En esta nueva etapa, la palabra clave no es técnica, sino epistémica: criterio. ¿Qué significa saber programar en una época en que los programas se escriben solos? Significa entender qué está haciendo el sistema. Cuándo está fallando. Cuándo está sesgado. Cuándo está optimizando en exceso. Cuándo está priorizando un resultado a expensas de otros. Cuándo nuestra orden no es clara, y cuándo lo es demasiado.

En el fondo, se trata de entender la relación entre lenguaje, intención y acción. La IA puede interpretar nuestra frase y devolvernos un bloque de código. Pero nosotros seguimos siendo responsables de lo que ese código hace. De si escala sin control. De si discrimina. De si filtra. De si actúa por su cuenta. La ética, en este nuevo contexto, no es un agregado externo: es parte del diseño del sistema desde el primer momento.

No se trata solo de escribir mejor. Se trata de pensar mejor.

Una nueva división del trabajo entre humanos y máquinas

Si algo revela este nuevo paisaje es que estamos entrando en una era de colaboración constante con sistemas que superan nuestras capacidades en velocidad, memoria y procesamiento, pero no necesariamente en juicio. El valor humano no desaparece: se redefine. Ya no somos quienes hacemos todas las tareas, pero sí quienes decidimos qué tareas se hacen, cómo se hacen y con qué objetivos.

Esta nueva división del trabajo implica aceptar una pérdida de control técnico en los detalles, pero asumir una mayor responsabilidad en el diseño global. Si antes el programador se ocupaba del “cómo”, ahora debe especializarse en el “por qué” y el “para qué”. Esa transición no es menor. Implica abandonar el orgullo de la ejecución perfecta para abrazar la complejidad de la supervisión imperfecta.

Pero también abre puertas. Personas sin formación técnica, con visión estratégica, con sensibilidad social o estética, pueden ahora participar activamente en el diseño de herramientas digitales. El desarrollo deja de ser un privilegio de los iniciados y se convierte en una conversación más amplia. En ese sentido, estamos más cerca de una democratización real de la tecnología. Pero solo si quienes acceden a ella comprenden también sus límites.

Enseñar sin nostalgia

El mayor riesgo que enfrentan hoy las instituciones educativas es confundir actualización con resignación. No se trata de dejar de enseñar programación porque la IA la haga mejor. Se trata de enseñar a entender lo que hace la IA. A convivir con ella sin perder agencia. A traducir problemas humanos a instrucciones digitales sin perder el hilo de la responsabilidad.

Lo que debería enseñarse, entonces, no es solo sintaxis ni semántica de un lenguaje de programación. Debería enseñarse cómo formular preguntas, cómo evaluar consecuencias, cómo estructurar procesos, cómo identificar sesgos, cómo dialogar con sistemas que aprenden, se ajustan, escalan y, a veces, fallan.

Aprender a programar en 2025 no es un anacronismo. Es un desafío distinto. No se trata de formar programadores como los de 2010, sino pensadores capaces de habitar este nuevo espacio entre lo humano y lo automático. Pensadores que no escriban código por necesidad, sino por decisión. Porque entienden lo que pasa cuando lo hacen. Y lo que podría pasar si no lo hicieran.

El arte de seguir entendiendo

La historia de la tecnología está llena de habilidades que fueron esenciales durante un tiempo y luego se volvieron invisibles. Muchos saben manejar un auto, pero no cómo funciona el motor. Pocos saben reparar un televisor, pero todos usan una pantalla. El código podría seguir ese camino. Pero eso no significa que debamos dejar de comprenderlo.

Programar nunca fue solo escribir instrucciones. Fue, desde el inicio, una forma de conversar con lo inerte para volverlo activo. Una forma de modelar ideas, traducir lógicas, explorar alternativas. Esa práctica, aunque cambie de forma, no pierde su valor. Porque en un mundo automatizado, la verdadera diferencia no la marca quien ejecuta mejor, sino quien entiende mejor lo que se está ejecutando.

Mientras existan decisiones que deban tomarse con criterio, sensibilidad y juicio, el pensamiento computacional seguirá siendo un territorio humano. Un arte discreto. Un modo de seguir entendiendo cómo funciona el mundo… incluso cuando ya no necesitemos escribirlo a mano.