En la historia de la informática, el momento decisivo no fue la invención del hardware, sino la estandarización del sistema operativo. Antes de Windows o Linux, cada computadora requería instrucciones específicas para su arquitectura única. La robótica moderna se encuentra atrapada en esa era pre-estándar: cada brazo robótico, cada pinza y cada base móvil exige un código de control personalizado, escrito laboriosamente por ingenieros para tareas específicas. Physical Intelligence, una startup fundada apenas en 2024, ha irrumpido en escena con una valoración de 5.600 millones de dólares tras recaudar 600 millones en una ronda liderada por CapitalG de Alphabet, apostando a que puede ser el "sistema operativo universal" de la realidad física.

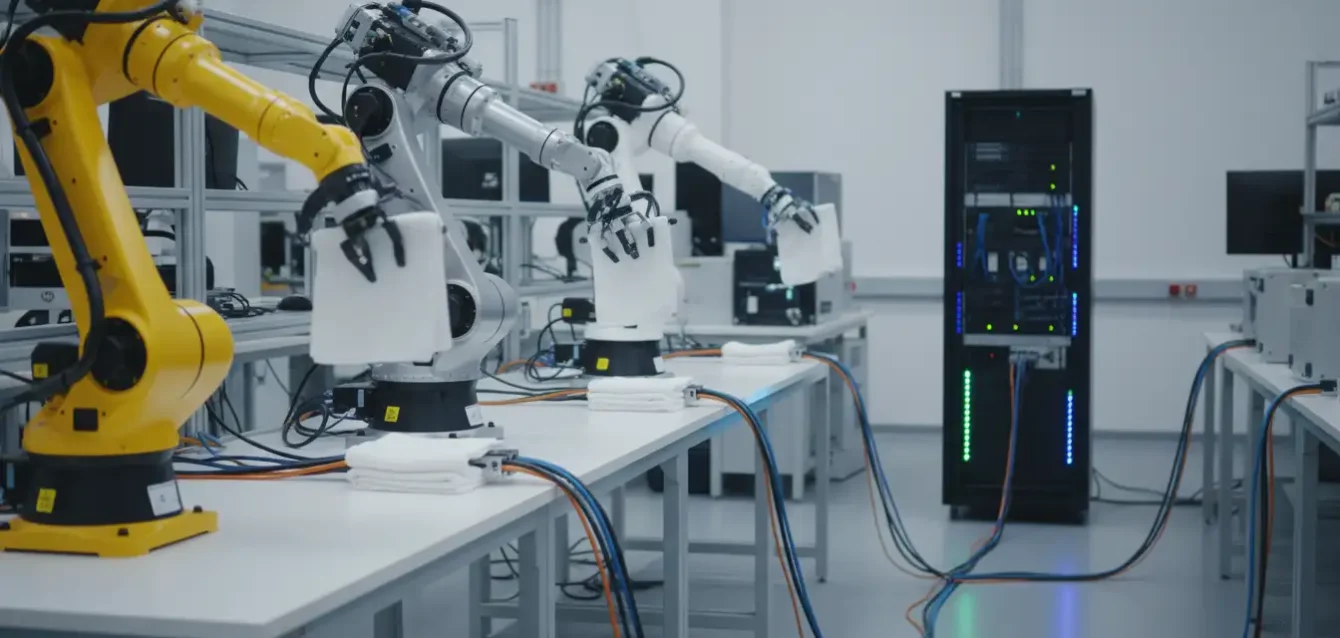

La tesis central de la compañía es audaz en su simplicidad técnica pero titánica en su ejecución: construir un único cerebro general (un modelo fundacional) que pueda enchufarse a múltiples cuerpos robóticos diferentes. En lugar de programar explícitamente las coordenadas de movimiento para un brazo de la marca A y luego reescribir todo para la marca B, Physical Intelligence propone un modelo que ingiere flujos de cámaras y sensores, comprende escenas 3D desordenadas en tiempo real y emite comandos motores precisos y seguros, independientemente de la morfología del robot que ejecute la acción.

Esta visión ha atraído a una coalición de inversores de peso pesado porque ataca el cuello de botella fundamental de la automatización. Si el software deja de ser específico del hardware, la robótica podría experimentar el mismo tipo de explosión cámbrica que el software de PC vivió en los años 90. No se trata de hacer un robot mejor, sino de hacer que todos los robots existentes sean instantáneamente más capaces mediante una actualización de software.

El pedigrí técnico: De DeepMind a la lavandería

El equipo detrás de Physical Intelligence no es un grupo de novatos. Está compuesto por ex investigadores de Google DeepMind y académicos de élite en robótica, una fusión de la teoría del aprendizaje profundo de vanguardia con la pragmática "sucia" de la ingeniería mecánica. Su enfoque se aleja de la robótica clásica basada en reglas (donde se le dice al robot: "mueve la articulación 1 a 30 grados") hacia modelos de visión-lenguaje-acción (VLA) entrenados masivamente.

Actualmente, el software está siendo sometido a pruebas de estrés en escenarios que deliberadamente mezclan la motricidad fina del hogar con la eficiencia bruta del almacén. Los brazos robóticos controlados por este modelo único están doblando ropa (una tarea notoriamente difícil debido a la naturaleza deformable de la tela), preparando bebidas calientes y ensamblando cajas de cartón. Que la misma política neuronal pueda manejar la rigidez del cartón y la fluidez de una camisa de algodón demuestra una capacidad de generalización que ha eludido a la industria durante décadas.

🤖 El Modelo Universal en Acción

El Reto de la Ropa: Doblar una camisa requiere percepción continua. La tela cambia de forma impredecible. El modelo ajusta su agarre en milisegundos basándose en la retroalimentación visual, no en una geometría precalculada.

El Reto del Almacén: Ensamblar cajas exige fuerza y precisión espacial. El mismo modelo cambia de "modo delicado" a "modo industrial" sin necesidad de recargar un programa diferente.

La Implicación: Un almacén logístico podría reasignar robots de empaquetado a tareas de limpieza o mantenimiento simplemente pidiéndoselo, sin llamar al equipo de integración de sistemas para reprogramar las unidades.

Aprendizaje por Refuerzo: El motor de la eficiencia

El avance técnico más reciente de la compañía, revelado junto con la noticia de la financiación, es un nuevo modelo de visión entrenado mediante aprendizaje por refuerzo (RL). A diferencia del aprendizaje supervisado, donde el robot imita demostraciones humanas, el RL permite que el robot "juegue" dentro de la tarea, recibiendo recompensas digitales por acciones exitosas (como doblar la caja correctamente) y penalizaciones por fallos.

Este enfoque permite que el sistema descubra secuencias de acción que un humano quizás no le enseñó explícitamente pero que resultan ser más eficientes o estables. Los resultados reportados son significativos: la compañía afirma haber duplicado el rendimiento (throughput) en comparación con los métodos de control anteriores. Sus brazos robóticos ahora pueden operar de forma continua durante bloques de 3 horas, manejando cada ítem en aproximadamente 3 minutos y completando el ensamblaje de una caja en unos 2.5 minutos.

La economía de la valoración de $5.600 millones

Para el observador casual, una valoración de 5.600 millones de dólares para una empresa fundada en 2024 podría parecer una burbuja especulativa. Sin embargo, esta cifra refleja la escasez de activos en el espacio de la "IA Física". Mientras que los LLMs (Modelos Grandes de Lenguaje) como GPT-4 han mercantilizado la generación de texto e imagen, el mundo físico sigue siendo un territorio virgen y hostil para la IA. Los datos de entrenamiento para robots son escasos, difíciles de recopilar y no se pueden simplemente "scrapear" de internet como el texto.

Los inversores están apostando a que Physical Intelligence posee la receta secreta para la eficiencia de datos. Si su modelo puede aprender tareas complejas sin necesitar millones de horas de teleoperación humana, se convierte en un activo estratégico de primer orden. CapitalG, Khosla Ventures y otros no están pagando por los robots actuales, sino por la posibilidad de poseer la plataforma estándar sobre la que se ejecutarán los robots de la próxima década.

El problema de la fragmentación del hardware

El mayor obstáculo para Physical Intelligence no es el algoritmo, sino la realidad mecánica. A diferencia de los procesadores, que están altamente estandarizados (x86, ARM), los robots varían enormemente en cinemática, sensores, actuadores y latencia. Un brazo de KUKA no se mueve igual que uno de Franka Emika; una cámara RealSense tiene un ruido diferente a una cámara Azure Kinect.

Crear un modelo que sea verdaderamente agnóstico al hardware requiere una capa de abstracción casi mágica. El modelo debe entender la intención ("agarrar la taza") y traducirla a comandos motores específicos para la anatomía particular del robot que está controlando en ese momento. Si fallan en esto, terminarán siendo solo otra consultora de robótica de alta gama que hace integraciones personalizadas, lo que destruiría la premisa de su valoración multimillonaria.

⚠️ Riesgos de la generalización prematura

Latencia crítica: Un modelo gigante que funciona en la nube puede ser demasiado lento para controlar un robot industrial que requiere ajustes de milisegundos para no aplastar un objeto o dañar a un humano.

La brecha de la simulación (Sim-to-Real): Lo que funciona en un entorno de RL simulado a menudo falla catastróficamente en el mundo real debido a la fricción, la iluminación variable y el desgaste mecánico.

Seguridad: Un modelo de propósito general es, por definición, menos predecible que un código dedicado. Garantizar que el "cerebro universal" no alucine un movimiento peligroso es el desafío regulatorio número uno.

La carrera por la IA encarnada

La inyección de capital en Physical Intelligence marca el inicio oficial de la fase 2 de la revolución de la IA: la IA encarnada (Embodied AI). Ya hemos resuelto en gran medida la inteligencia digital (chatbots, generadores de código); ahora el capital se está moviendo masivamente hacia la inteligencia que puede manipular átomos.

Si Physical Intelligence tiene éxito, el modelo de negocio de la robótica cambiará de vender hardware (hierro) a vender inteligencia (licencias de software). Los fabricantes de robots se convertirán en fabricantes de cuerpos, commoditizados y baratos, mientras que el valor real residirá en el cerebro alquilado en la nube que les dice cómo moverse. Es una apuesta de alto riesgo con una recompensa tecnológica incalculable: liberar a las máquinas de la rigidez de su programación original.

Referencias

Physical Intelligence Technical Report: "Reinforcement Learning for General Purpose Robotic Manipulation".

Google DeepMind Robotics Research - Antecedentes sobre modelos VLA (Vision-Language-Action).

CapitalG Investment Thesis - Perspectivas sobre la inversión en infraestructura de IA física.

Estudios sobre "Sim-to-Real Transfer" en robótica - Contexto académico sobre los desafíos del aprendizaje por refuerzo.