Imaginen por un instante que la humanidad ha descubierto un nuevo continente. Un vasto territorio inexplorado, desprovisto de mapas, rebosante de recursos inimaginables y con un potencial capaz de transformar la civilización para siempre. Este continente no está hecho de tierra y roca, sino de datos y algoritmos. Su nombre es inteligencia artificial. Como en las grandes eras de exploración, las potencias mundiales se han lanzado a una carrera frenética por cartografiarlo, explotar sus riquezas y, sobre todo, establecer las reglas que lo gobernarán.

En esta nueva era de descubrimientos, tres grandes navegantes lideran la expedición, cada uno con un barco, una brújula y una filosofía radicalmente diferente. Desde el oeste, zarpa Estados Unidos, con las velas de la innovación privada y el libre mercado desplegadas al máximo, impulsado por gigantes corporativos que actúan con una agilidad y una ambición sin precedentes.

Desde el este, avanza China, un coloso navío estatal cuyo rumbo está firmemente marcado por el gobierno, moviéndose con una disciplina y una coordinación formidables. Y entre ambos, navega la Unión Europea, una flota diversa y compleja, que avanza con cautela, más preocupada por diseñar las leyes de navegación y proteger los derechos de los futuros habitantes de este mundo que por ser la primera en clavar su bandera en la cima más alta.

Esta metáfora ilustra la encrucijada geopolítica y tecnológica en la que nos encontramos. La inteligencia artificial, o IA, ha dejado de ser un concepto relegado a la ciencia ficción para convertirse en el motor invisible que impulsa una parte creciente de nuestro mundo. No se trata únicamente de robots humanoides o de superordenadores que juegan al ajedrez. La IA es el sistema que te recomienda una película en tu plataforma de streaming, el software que traduce una conversación en tiempo real, la herramienta que ayuda a los médicos a detectar tumores con una precisión asombrosa y el algoritmo que gestiona la logística de una cadena de suministro global. Hablar de su «adopción» es hablar de la integración profunda de estas capacidades en el tejido de nuestra economía y nuestra sociedad.

Para una empresa, adoptar la IA puede significar automatizar tareas repetitivas, optimizar la producción o crear servicios completamente nuevos. Para un país, implica fomentar un ecosistema donde la investigación florezca, el talento se desarrolle y las industrias se modernicen, generando un círculo virtuoso de prosperidad y competitividad.

En esta competición global, las estrategias divergen profundamente. Estados Unidos confía en la dinámica del capitalismo de riesgo y en la supremacía de sus titanes tecnológicos para liderar la vanguardia. China, por su parte, ejecuta un plan maestro orquestado desde el poder central, donde la tecnología es una herramienta estratégica para el desarrollo económico y el control social. La Unión Europea, fiel a su historia y a sus valores, ha elegido un tercer camino: el de la regulación. Su gran apuesta es la Ley de Inteligencia Artificial, un marco normativo pionero y exhaustivo que busca crear un ecosistema de IA fiable y centrado en el ser humano.

La premisa europea es que la confianza es la base para una adopción tecnológica sólida y sostenible. Sin embargo, esta aproximación prudente ha desatado un debate de enormes proporciones. ¿Es esta legislación un escudo que protegerá los derechos fundamentales de los ciudadanos y convertirá a Europa en un referente mundial de la IA ética? ¿O se trata, por el contrario, de una barrera burocrática que frenará la innovación, dejará a sus empresas en desventaja y la convertirá en una mera consumidora de tecnología desarrollada en otras latitudes?

Aquí exploraremos las facetas de este dilema, analizando el tablero mundial de la IA, desgranando la ambiciosa propuesta regulatoria europea y ponderando los riesgos de que la cautela se transforme en un rezago tecnológico con consecuencias irreversibles.

El tablero mundial de la inteligencia artificial

Para comprender la posición de Europa, primero es necesario analizar el entorno en el que compite. El panorama global de la inteligencia artificial está dominado por dos superpotencias claras, cada una con un modelo de desarrollo que refleja su sistema político y económico.

Estados Unidos se erige como la cuna de la innovación impulsada por el sector privado. Es el hogar de las empresas que definieron la era de internet y que ahora lideran la revolución de la IA. Corporaciones como Google, Microsoft, Meta y Amazon no solo poseen una capacidad de investigación y desarrollo que rivaliza con la de muchos estados, sino que también controlan las infraestructuras de computación en la nube y los vastos océanos de datos que son indispensables para entrenar los modelos algorítmicos más avanzados.

Este ecosistema se nutre de un flujo constante de capital riesgo que busca activamente la próxima idea disruptiva y de una cultura que premia la velocidad y la experimentación. El enfoque estadounidense ha sido, tradicionalmente, el de innovar primero y regular después, si es necesario. Esta filosofía ha permitido un desarrollo tecnológico vertiginoso, pero también ha generado debates sobre la concentración de poder en pocas manos, la desinformación, la erosión de la privacidad y los sesgos algorítmicos.

En el otro extremo del espectro se encuentra China, cuyo ascenso en el campo de la IA ha sido meteórico y deliberado. El gobierno chino identificó esta tecnología como una prioridad estratégica nacional y ha movilizado ingentes recursos públicos para alcanzar el liderazgo mundial. Su modelo se caracteriza por una simbiosis entre el Estado y las grandes empresas tecnológicas del país, como Baidu, Alibaba y Tencent.

El gobierno establece los objetivos, financia la investigación fundamental y facilita el acceso a enormes conjuntos de datos, en parte gracias a un marco de privacidad de datos menos restrictivo para sus ciudadanos. Esta aproximación centralizada permite una ejecución rápida y a gran escala, alineando el desarrollo tecnológico con las metas nacionales de crecimiento económico y seguridad. Sin embargo, este modelo también plantea serias preocupaciones a nivel internacional sobre el uso de la IA para la vigilancia masiva, la censura y el control social, encarnado en su sistema de crédito social.

En este contexto, la Unión Europea se presenta como un actor con una propuesta singular. No compite en la misma escala de inversión privada que Estados Unidos ni posee la capacidad de movilización estatal de China. Su fortaleza histórica reside en su mercado único, su excelencia en ciertos nichos de investigación industrial y, sobre todo, en su poder normativo.

La UE ha demostrado una y otra vez su capacidad para establecer estándares globales a través de la legislación, un fenómeno conocido como el «efecto Bruselas». El Reglamento General de Protección de Datos (RGPD) es el ejemplo más claro: aunque es una ley europea, ha obligado a empresas de todo el mundo a adaptar sus prácticas de privacidad.

Con la inteligencia artificial, Bruselas aspira a repetir esta hazaña, posicionándose como el árbitro global de la tecnología ética y fiable. La gran incógnita es si, en una carrera definida por la velocidad y la escala, un enfoque basado en la deliberación y la regulación puede resultar ganador.

La ley de inteligencia artificial: ¿Un escudo o una barrera?

La pieza central de la estrategia europea es la Ley de Inteligencia Artificial, conocida comúnmente como AI Act. Se trata del primer intento a nivel mundial de regular de forma horizontal esta tecnología. Su enfoque no consiste en regular la IA como un concepto abstracto, sino en gestionar los riesgos específicos que sus distintas aplicaciones pueden generar. Para entender su lógica, podemos pensar en cómo la sociedad regula otros productos. No aplicamos las mismas exigencias a un juguete infantil que a un avión comercial o a un medicamento. La normativa se ajusta al peligro potencial.

La Ley de IA clasifica los sistemas de inteligencia artificial en cuatro categorías de riesgo. En la base de la pirámide se encuentra el riesgo mínimo, que abarca la gran mayoría de las aplicaciones, como los filtros de correo no deseado o los sistemas de IA en los videojuegos. Para estos sistemas, la ley no impone ninguna nueva obligación, permitiendo la libre innovación.

Un escalón por encima está el riesgo limitado, donde se sitúan sistemas como los chatbots o los «deepfakes». Aquí, la exigencia principal es la transparencia: los usuarios deben ser informados de que están interactuando con una máquina o viendo un contenido generado artificialmente, para que puedan tomar una decisión consciente.

El corazón de la regulación se encuentra en la categoría de alto riesgo. Aquí se incluyen los sistemas de IA cuyas fallas podrían tener consecuencias graves para la seguridad o los derechos fundamentales de las personas. La lista es extensa e incluye la IA utilizada en infraestructuras críticas como el transporte o la red eléctrica, en la selección de personal, en la evaluación de la solvencia crediticia, en el diagnóstico médico o en aplicaciones utilizadas por las fuerzas del orden y la justicia.

Los desarrolladores de estos sistemas deberán cumplir requisitos muy estrictos antes de poder comercializarlos en el mercado europeo. Entre otras cosas, tendrán que garantizar la alta calidad de los datos con los que entrenan sus algoritmos para evitar sesgos discriminatorios, mantener una documentación técnica detallada, ofrecer un alto nivel de precisión y seguridad, y asegurar una supervisión humana efectiva.

Finalmente, en la cúspide de la pirámide, la ley define una categoría de riesgo inaceptable. Se trata de aquellas aplicaciones de IA que se consideran una amenaza tan clara para los valores y los derechos de la Unión que quedan directamente prohibidas. Esto incluye, por ejemplo, los sistemas de puntuación social operados por gobiernos, las técnicas subliminales que puedan manipular el comportamiento de las personas de forma perjudicial o la explotación de las vulnerabilidades de grupos específicos. También prohíbe, con contadas excepciones para delitos graves, el uso de sistemas de identificación biométrica remota en tiempo real en espacios públicos, como el reconocimiento facial masivo.

El objetivo de este diseño es doble. Por un lado, busca proteger a los ciudadanos de los posibles perjuicios de una tecnología extraordinariamente potente. Por otro, intenta generar un marco de seguridad jurídica que fomente la confianza tanto en los consumidores como en las empresas, con la esperanza de que esta confianza se traduzca en una adopción más profunda y generalizada a largo plazo.

Sus defensores argumentan que, al establecer reglas claras, la UE está creando un mercado para una IA de calidad, segura y ética, lo que podría convertirse en una ventaja competitiva. Sin embargo, sus detractores advierten de que la complejidad de la ley, los costes asociados al cumplimiento y la lentitud inherente al proceso regulatorio podrían ahogar la innovación, especialmente para los actores más pequeños del ecosistema.

El dilema de las pequeñas y medianas empresas europeas

El verdadero campo de pruebas para la estrategia europea no serán los gigantes tecnológicos, que cuentan con ejércitos de abogados e ingenieros para adaptarse a cualquier nueva normativa. El éxito o el fracaso del enfoque de la UE dependerá de su impacto en las pequeñas y medianas empresas (PYMES), que constituyen la espina dorsal de la economía del continente. Son estas empresas las que necesitan adoptar la inteligencia artificial para modernizarse, mejorar su productividad y competir en un mercado global, pero son también las más vulnerables a las barreras de entrada.

Para una startup o una PYME europea que quiera desarrollar o implementar una solución de IA, los desafíos son considerables. A la dificultad de competir por el escaso talento especializado y de acceder a grandes volúmenes de datos de calidad, se suma ahora la necesidad de navegar un marco regulatorio denso y exigente. Determinar si un producto entra en la categoría de «alto riesgo», cumplir con todos los requisitos de documentación y certificación, y asumir la responsabilidad legal correspondiente puede representar una carga desproporcionada para una organización con recursos limitados.

El temor de muchos emprendedores e inversores es que esta carga regulatoria incentive una de dos cosas: o bien que la innovación se desplace hacia áreas de «bajo riesgo» menos ambiciosas, o bien que las empresas europeas se vuelvan excesivamente adversas al riesgo, retrasando la adopción de herramientas de IA que sus competidores en Estados Unidos y China ya están utilizando para ganar eficiencia y cuota de mercado.

La ley contempla la creación de «entornos controlados de pruebas» (sandboxes regulatorios), espacios donde las empresas pueden experimentar con nuevas tecnologías bajo la supervisión de las autoridades antes de su lanzamiento. Esta iniciativa busca mitigar el problema, pero persiste la duda de si será suficiente para contrarrestar la percepción de que Europa es un lugar más difícil para innovar en IA que otras regiones.

Las principales barreras que enfrentan estas empresas se pueden resumir en dos puntos clave:

- Acceso limitado a la financiación y a los datos de alta calidad, elementos indispensables para el desarrollo de sistemas de IA competitivos.

- Complejidad regulatoria y costes de cumplimiento normativo, que pueden desviar recursos valiosos del desarrollo de productos y la investigación.

Si Europa no consigue crear un entorno en el que sus PYMES puedan prosperar en la era de la IA, corre el riesgo de que su ambiciosa regulación solo sirva para gobernar un mercado dominado por tecnología importada, perdiendo la oportunidad de generar su propio tejido industrial y su soberanía tecnológica.

El coste de la cautela: ¿Se está quedando atrás Europa?

Mientras Europa debate y perfecciona su marco regulatorio, los datos sobre inversión y adopción de la inteligencia artificial dibujan un panorama preocupante. Diferentes informes y análisis de mercado señalan una brecha creciente entre el continente europeo y los dos líderes indiscutibles, Estados Unidos y China. Esta brecha no se manifiesta en la calidad de la investigación académica, donde Europa sigue manteniendo un alto nivel, sino en la capacidad de transformar esa investigación en productos comerciales y en la velocidad con la que las empresas integran estas soluciones en sus operaciones.

Las métricas de inversión privada son particularmente elocuentes. La financiación de startups de IA en Estados Unidos y, en menor medida, en China, supera con creces las cifras europeas. Este capital no solo acelera el desarrollo de nuevas tecnologías, sino que también atrae talento de todo el mundo, creando un efecto de concentración difícil de revertir. De manera similar, si se observa el número de patentes relacionadas con la IA o la cantidad de «unicornios» (empresas tecnológicas valoradas en más de mil millones de dólares) en este campo, Europa aparece en una posición rezagada.

Las consecuencias de este posible retraso van más allá de una simple estadística en un ranking de competitividad. Una adopción más lenta de la IA puede traducirse en un menor crecimiento de la productividad en sectores clave como la manufactura, las finanzas, la sanidad o la logística, industrias en las que Europa ha sido tradicionalmente líder.

A largo plazo, esto podría erosionar su posición económica global. Además, surge una preocupación estratégica fundamental: la de la soberanía digital. Una dependencia excesiva de la tecnología de IA desarrollada y controlada por empresas o gobiernos extranjeros podría dejar a Europa vulnerable en áreas críticas, desde la seguridad de sus infraestructuras hasta la protección de los datos de sus ciudadanos y empresas.

El debate, por lo tanto, se centra en si la aproximación europea es una estrategia de largo aliento que finalmente dará sus frutos o una receta para la irrelevancia tecnológica. Sus partidarios sostienen que al priorizar la seguridad y la ética, Europa está sentando las bases para un modelo de IA más robusto y socialmente aceptado, que evitará los contratiempos y las crisis de confianza que podrían frenar a sus competidores en el futuro. Sus críticos, en cambio, argumentan que en una carrera tecnológica exponencial, quien toma la delantera al principio acumula ventajas (más datos, más talento, más experiencia) que se vuelven casi insuperables. Desde esta perspectiva, la cautela europea, por muy bien intencionada que sea, podría tener un coste de oportunidad demasiado alto.

Más allá del código: La batalla por el talento y los datos

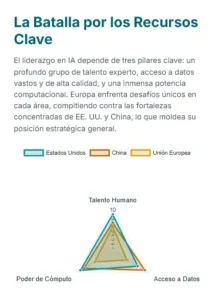

La competición por el liderazgo en inteligencia artificial no se libra únicamente en el terreno de los algoritmos o los marcos regulatorios. Se decide, fundamentalmente, en la capacidad para atraer y retener tres recursos estratégicos: el talento humano, los datos y la potencia de cálculo. En estas tres áreas, Europa enfrenta desafíos significativos.

El recurso más preciado es el talento. La demanda de investigadores, ingenieros y científicos de datos especializados en IA supera con creces la oferta en todo el mundo. Las universidades europeas producen profesionales de altísimo nivel, pero a menudo estos se ven atraídos por los salarios más altos, las oportunidades de investigación con mayores recursos y la cultura de innovación de las grandes empresas tecnológicas y las startups de Estados Unidos. Este fenómeno de «fuga de cerebros» priva al ecosistema europeo de la masa crítica necesaria para competir al más alto nivel. Revertir esta tendencia requiere no solo invertir en educación, sino también crear un entorno empresarial y científico más dinámico y atractivo.

El segundo pilar son los datos, el combustible que alimenta a los modelos de aprendizaje automático. La calidad, la cantidad y la accesibilidad de los datos son determinantes para la eficacia de cualquier sistema de IA. En este aspecto, la UE opera en un paradigma diferente al de sus competidores. El RGPD, si bien es un hito en la protección de la privacidad, impone restricciones sobre cómo se pueden recopilar, usar y compartir los datos personales.

Esto contrasta con el acceso a datos a gran escala que tienen las empresas en Estados Unidos (a través de sus plataformas globales) y en China (con el apoyo del Estado). Para algunos, esto es una desventaja competitiva insalvable. Para otros, es un incentivo para que Europa lidere el desarrollo de técnicas de IA más eficientes y respetuosas con la privacidad, como el aprendizaje federado (que permite entrenar modelos sin centralizar los datos) o el uso de datos sintéticos.

Finalmente, la potencia de cálculo, materializada en los chips avanzados (como las GPU) y las infraestructuras de computación en la nube, es la maquinaria que permite procesar esos datos y entrenar los modelos complejos. Este es otro sector dominado por empresas no europeas, principalmente estadounidenses y asiáticas. Aunque Europa está realizando esfuerzos para reforzar su capacidad de producción de semiconductores y desarrollar sus propias infraestructuras en la nube, la dependencia actual sigue siendo un factor de vulnerabilidad estratégica.

Trazando el futuro en un mundo inteligente

El mundo se encuentra en un punto de inflexión histórico, un momento en el que las decisiones que tomemos sobre la inteligencia artificial darán forma a la economía, la política y la sociedad del siglo XXI. La carrera por liderar esta transformación tecnológica no es una simple competición económica; es un debate fundamental sobre los valores que deben guiar el progreso. Estamos presenciando la emergencia de tres visiones distintas del futuro digital. La visión estadounidense, impulsada por un optimismo tecnológico y las fuerzas del mercado; la visión china, definida por la planificación estatal y la búsqueda de la estabilidad social; y la visión europea, que aspira a forjar un camino intermedio donde la innovación y los derechos humanos avancen de la mano.

Ninguno de estos senderos está exento de riesgos. El modelo de libre mercado puede conducir a desigualdades y a una concentración de poder que desafíe a los propios estados democráticos. El modelo de control estatal puede derivar en un autoritarismo tecnológico que anule las libertades individuales. Y el modelo regulatorio, el elegido por Europa, corre el peligro de sofocar la creatividad y la agilidad, condenando a la región a un papel secundario en una revolución que ella misma ayudó a iniciar.

La Ley de Inteligencia Artificial es la apuesta más audaz de Europa. Es un intento de exportar sus valores al mundo digital, de demostrar que es posible construir una tecnología poderosa que sirva a la humanidad sin socavar sus principios fundamentales. El desafío es monumental: lograr un equilibrio casi perfecto entre la protección y el fomento, entre la precaución y el progreso.

El éxito de esta empresa no solo determinará el lugar de Europa en el nuevo orden mundial, sino que podría establecer un precedente global para el desarrollo responsable de la inteligencia artificial. El continente que en su día lideró la Ilustración se enfrenta ahora a la tarea de iluminar el camino hacia un futuro inteligente que sea, ante todo, profundamente humano.

Referencias

Bradford, A. (2020). The Brussels Effect: How the European Union Rules the World. Oxford University Press.

Comisión Europea. (2021). Propuesta de Reglamento del Parlamento Europeo y del Consejo por el que se establecen normas armonizadas en materia de inteligencia artificial (Ley de Inteligencia Artificial).

Lee, K.F. (2018). AI Superpowers: China, Silicon Valley, and the New World Order. Houghton Mifflin Harcourt.

McKinsey Global Institute. (2023). The state of AI in 2023: Generative AI’s breakout year.

Stanford University Institute for Human-Centered Artificial Intelligence (HAI). (2023). Artificial Intelligence Index Report 2023.